自从2022年底ChatGPT横空出世以来,在过去的十几个月里,生成式人工智能的浪潮席卷并改变着各行各业。

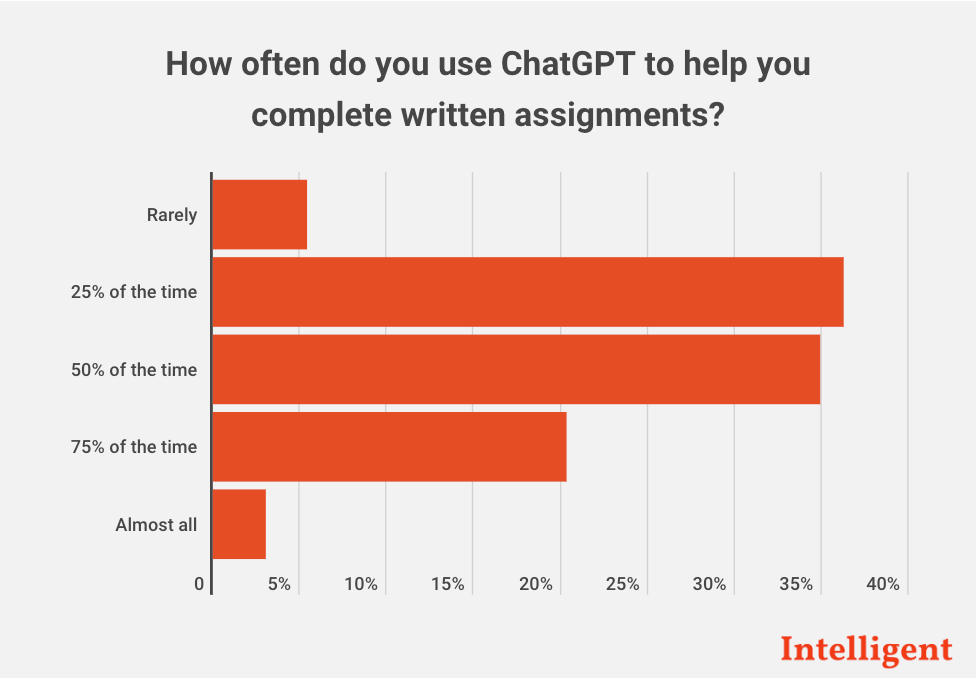

2023年一月,在线课程供应商Study.com曾向1000名18岁以上的学生发起的一项调查显示,当时就已经有超过89%的学生使用ChatGPT来完成家庭作业,53%的学生用ChatGPT写论文。无独有偶,在线杂志Intelligent同时期针对在校大学生的一项研究也显示,有60%以上的受访者表示一半以上的作业都使用了ChatGPT。

图片来自Intelligent 2023年1月的调查研究

一年过去了,作为生成式AI技术最早的尝鲜者,这些普通用户是否还仍然每天在日常生活中使用ChatGPT,大模型是如何帮助他们学习的,他们的使用模式是否也在跟随着大模型的快速发展而在迭代升级?

带着这样的疑问,硅谷101访谈到了一位ChatGPT的高阶玩家——左斯琦。他是一位软件工程师,同时也是一位抱着学生的心态在持续学习如何与AI交互协作的顶级发烧友,目前他已经持续在各种AI模型上累计学习了1100个小时,知道OpenAI和大模型公司的每一次升级、每一次宕机,同时也即将亲自投身到大模型工作之中。此次,他从工作流程、使用场景、经验总结、心得体会等不同角度,为我们深入分享了作为一位普通用户他是如何“玩转” ChatGPT的。

以下是部分访谈精选:

一、如何使用ChatGPT来学习的五个步骤

硅谷101:听说你现在已经在ChatGPT上累计学习了大约一千一百个小时。非常好奇你是怎么使用的?

左斯琦:首先我想澄清一下,我统计了一下过去一年总的学习时间,也不是所有的时间都在ChatGPT上(还包括其他大语言模型工具)。我是从2022年11月左右在网上看到有这么一个很火的东西,然后就试了一下,觉得确实很有趣,从那个时候开始就会经常使用ChatGPT。

硅谷101:2022年11月应该就是ChatGPT刚刚发布的时候,所以你是在它发布之后就开始一直在使用了。我们之前有过一些简短的交流,你曾提到会用它来学哲学、证明数学公式,甚至跟自己的讨论,总体包括这几个大使用方向对吗?

左斯琦:我现在会使用它学很多东西。比如我会在上班之余上斯坦福的一些Graduate AI相关的课程,也上一些哲学课,同时平常也会看一些数学书和计算机相关的论文。在学习这些内容的过程中,ChatGPT都非常有用。我可以大概介绍一下我平常如何使用ChatGPT的工作流程。

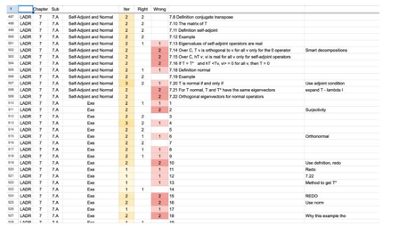

第一步,我会把我想学的东西让ChatGPT做一个简述,先让我有一个全局的理解。对于绝大部分的方向,这是一个比较通用的一个方法。举个例子,我会把想学的东西的文本给ChatGPT,让它帮我总结,告诉我全局上应该怎么理解,然后我会把它返回的答案记在Spreadsheet,一个类似于像EXCEL的一个表格里边。在我的学习生活中,很多东西都会用类似于EXCEL的这个表格来记录。

左斯琦的Spreadsheet,图片由左斯琦提供

第二步,除了数学之外,我会把这些总结的内容放在Audible或者Speechify软件里边反复听。比如我平常就会在上下班和在吃饭的时候去听它。

第三步,听完之后,我再回到我的Spreadsheet中进行复习,这个听和复习的过程可能通常会重复两三遍。接着我会用费曼法对自己进行自问自答,看自己能不能理解这个概念或问题。

第四步,当我觉得我大概理解了之后,我会用ChatGPT来对自己提问题。类似于我没有完全理解或者没有想到的一些比较细节的地方,我会让ChatGPT来读完这个文本,让它问我一些发散或者细节的问题,也可以问我一些可以延展到相关领域的问题,让其成为我下一个学习的东西。

第五步,我会用一个叫RAG的工具,相当于在用ChatGPT回答之前,让它先读一些之前在数据库里存的一些相关的文档或者文件,从而让它的回答更精确、更准确。我会拿它来进行一些研究和发现新的学习方向。比如,我会把我学习的一些论文,能找到的所有的论文,通过自己写一些脚本把它们存在一个数据库里边,接着用ChatGPT的API,让它在回答我的问题之前先去读这些文献,从而返回更准确的回答和给我一些更好的想法。这一步可能用的不是很多,但是前四步是我所有的学习都会用到的比较通用的路径。

硅谷101:听起来你的整个的学习方法是用了超级多的软件组合,比如第一步你用ChatGPT来做总结,记到Spreadsheet上。第二步,你用到了Audible和Speechify两个听的软件。第三步又回到了Spreadsheet上。第四步是继续用ChatGPT,第五步是用RAG加ChatGPT的API。 每一步都是在善用软件。

左斯琦:是的,我觉得过去的学习就相当于建造古埃及金字塔,你可能需要很多的人力,你可以把这些人力换算成自己的时间,然后用时间去堆一些东西。但是现在的这些工具就相当于推土机,我在做这些的过程就相当于我自己在开着推土机去完成自己的工程,会感觉对自己有所提高。

硅谷101:举个具体的例子,比如你在用这五步来学习哲学的时候,这个学习方法有在事实上去提高学习效率或者加深你的理解吗?

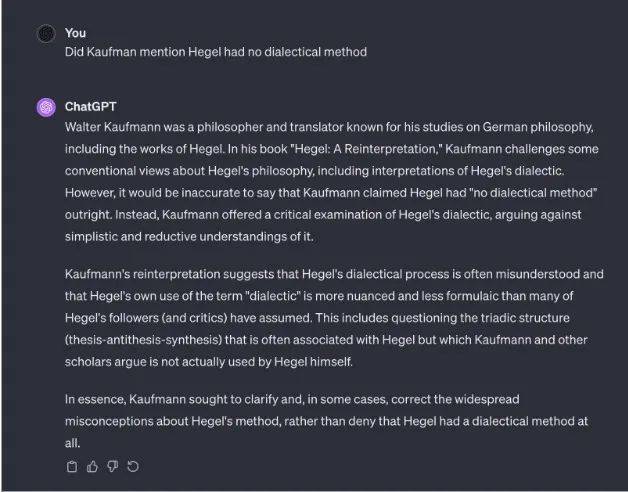

左斯琦:是的。你如果直接去用Google搜索一个问题,相较于使用第五步的RAG和API,是很难很快得到一个非常细节和准确的答案的。比如,我想知道有一个叫Kaufman的哲学家他说过黑格尔是没有说过辩证法这么一个东西的,他觉得黑格尔本身是没有辩证法。但当然大家都会觉得黑格尔辩证法、正反合是一个非常广泛的概念。于是我就想康夫曼到底是怎么得出这个结论的,然后就想知道有哪些文献、论文讲过这个事情。我的做法就是用第五步的RAG,把所有的这些东西都存到我的数据库里边。

硅谷101:所谓的RAG,我理解是你需要把这些历史上涉及到黑格尔辩证法的资料,比如各种PDF、网页文本都搜集起来再存进去,对吧?

左斯琦:对,存进去之后我对它提出了这个问题,它就会从所有的这些文献文档里找出相关的资料。然后我会先让ChatGPT读一下这些文献,再给出答案,这样就比只用ChatGPT来回答更准确。同时,它也会告诉我一些我需要学习的文献方向,大大提高我的学习和搜索能力。这个比我直接去Google花好几个小时自己读自己学习要高效很多,它能在几分钟之内给我一个比较准确的答案。

硅谷101:但是你怎么找这些文献呢?找这些文献不也是个做搜索和整理的一个过程吗?

左斯琦:文献的搜索确实需要一些时间,但好处是你只需要把这些文献下载下来一次,比如几百篇、几千篇,甚至很多,你之后就可以基于这些资料无限地问ChatGPT问题。如果按平常的办法的话,你想回答一百个问题你可能需要把它全部自己读一遍,因为你每次可能读完文献之后想再回到那个文献,你已经忘了很多东西了,那些相关的文字在你的脑子里已经没有印象了。所以,如果有这么一个系统,再加上一个能帮你从文献里找到关键内容的ChatGPT它就会非常有效,可以大大地节省时间。

硅谷101:你把这些文献都放到RAG里了,让 ChatGPT 基于你的这么大的一个数据样本量去做总结,但它现在的上传不是有一些TOKEN的限制吗?所以这个过程是怎么实现的呢?

左斯琦:这个过程并不是把所有的文献都直接扔进去。第一步是先找出我问的这个问题Kaufman,第二个是辩证法,它(RAG系统)就会把Kaufman和辩证法这些相关的文献和最关键的东西自动找出来,这不是由ChatGPT完成的。这一步结束之后,才会把找出来最相关的这些文献让ChatGPT阅读,再让ChatGPT回答我刚才那个问题。所以ChatGPT只是把最相关的东西读了,而不是把所有的文献都读了。

硅谷101:所以第一步你是把Kaufman说黑格尔有没有提到辩证法的所有相关文献都摘取出来,第二步是你把这些摘取的资料再放到ChatGPT里面,让它来总结。

左斯琦:如果有一万篇这样的文档,ChatGPT不需要读一万篇,它只需要读一两篇和问题最相关的。

硅谷101:我感觉这是一个高阶搜索,相当于给ChatGPT装了一个人类知识库的翅膀,所以可以大大提高它的能力。所以你最后的结论是什么,黑格尔有提过辩证法吗?

左斯琦:其实学哲学都不是有一个固定的答案的,每个人都会有一个自己的想法,目的就是你要找到更多的观点。我从这个问题可以很快地了解如Stanley Rosen等其他的那些研究学者说了什么,可以很快地得到这些反馈。它的目的不是说要得到像数学一样一个固定的答案,而是通过这个系统可以很快地给我想要的信息。当你自己创建这个RAG的时候,你就可以在你自己的系统里面去做这些事情。

硅谷101:你刚才提到的使用ChatGPT的方法,我觉得也给我们做深度新闻了一些小启发。比如我们要去写一个公司的细节,包括这个公司如何诞生的、之前它的创始人说了些什么、跟其他几个创始人的关系、跟董事会的关系等等,对于那种比较知名的公司其实互联网上可能有无数这样的资料,那是不是我们也可以用同样的方法去创建一个这样的资料库,根据我们设计的问题去寻找相关的资料,然后让ChatGPT去总结。

左斯琦:其实目前ChatGPT目前已经可以实现了。在GPT的开发者大会之后的那一天,就已经有一个叫GPTs的功能。你可以把你相关所有的PDF创建一个新的叫GPTs的东西上传,然后你就可以对这些文件问问题了。

硅谷101:那你还需要用RAG的程序吗?

左斯琦:根据我需求的具体情况切成多大多小的文本我有自己的方法。目前GPTs还做不到,它只能把整个的文件放进去。我是想具体细化到一小段一小段,但现在这GPTs没有办法定制到那个样子。

二、ChatGPT所带来的“哥白尼式翻转”

硅谷101:相当于你自己做的这套方法,它是有更多灵活性的。那你觉得这个方法主要是应用在哲学方向吗?那在数学方向呢?

左斯琦:我本科其实学的就是数学,也非常喜欢做证明。举个例子,比如说有些证明题,我想要证明两个东西是等价的,如果自己平常去想的话,需要看很多定理以及定理的背景,但是用ChatGPT的好处就是如果我有一些东西我确实是短时间内想不出来,我可以让它给我一些灵感,它并不是每次都可以做对,但是它会自己列出它的每一个思考步骤。每一步列出来之后,我就可以去看它哪里有问题,然后我再去反问它,这么几次之后,它一般也会给我比较正确的答案。

一般情况下,我的工作的流程是,我先会写一个提示词,第一句话是告诉ChatGPT说“你是一个数学专家”。第二句话是“我们一步一步地想”,当然其实都是用英文指令。接着ChatGPT在回答的时候它就会一步一步地把它的答案告诉我,然后我就会去看这个答案,从这一步到这一步,下一步到下一步,哪一步之间有幻化,就是它可能会胡说,或者是哪一步有理论上的错误。

这个的好处是什么呢?其实你想一想,平常你在学习东西的时候,你是被动学习,你有一堆内容然后你会想怎么拿到这些内容里的结构。你在回答问题的时候,你是一个做题者的角度,你在发散式地搜索,会想这个可能会有用、那个可能会有用,然后你再尝试给出一个答案。但是有了ChatGPT之后,你的角度就发生了一个翻转,有点像哲学上说的哥白尼式翻转。之前学习你是一个被动的接受者,现在我可以用ChatGPT来问我问题然后我可以回答它,然后在做题的时候,我可以从做题的角度去发散和挑战这个问题。这就变成了ChatGPT给我答案,而我变成了一个老师,我要看它哪里有错误。

这就给了一个更新的角度,进而大大提升我对这个问题的认知。因为我之前只是从一个方向去学习这个领域,而当你给了一个新的角度之后,你就将就可以看到之前看不到的很多东西,对知识的了解更细化,对整体把握也会有很大的提升。因此我觉得它最大的意义并不是它是否给了我正确或错误的答案,而是一个知识理解的角度的转变。

硅谷101:所以当你问ChatGPT问题的时候,其实也是为了看到它会给你一个什么角度的改变。

左斯琦:当我问ChatGPT问题的时候,有时候是带有攻击性的,就是相当于你要去挑战一个问题,想把它做出来。比如我想证明一个算子的空间和一个实数的空间是等价的,当它给出一个正确答案之后,我就会仔细看它给出的一二三四五六哪一步会有问题?当我在第二步或者第三步发现问题时,我就会去问它,你觉得这个第二步是对的吗?有什么问题?在这个过程中,我就变成了一个审视者的角度。我以前做题的时候是努力要自己想出这个一二三四五六,但现在我变成了老师,于是我的角度就发生了转变。

以前在思考的时候我是一个挑战者的角色,在搜索哪些知识点可以把这个问题解决出来,但我现在变成了一个防守者,我要挑战它哪里有问题。挑战的时候一般是发散思维你想得更多,而防守的时候你则想得更细更深。所以如果平常只做挑战者,你可能会漏掉很多细节。但是我有了这么一个更深更细的机会的时候,我就可以把我的知识变得更全面。

硅谷101:简单来说就是你的角色变了,你从以前一个学生的角色,现在变成了一个老师的角色。以前是别人出题你来做,现在是你出题ChatGPT来做,你来验证它的对错。

左斯琦:因为你要做验证的时候,你自己需要有足够的理解,所以你在验证它的过程中你会有很多的成长,会更细化地去想自己可能有哪些细节没有想清楚。

硅谷101:那会不会有时它做错了你没看出来,或者你也不知道这个问题的答案。

左斯琦:如果你已经完全知道这个东西的时候,一般你的学习也不会学到很多。但当你完全不知道的时候,其实你也学不到很多,因为你实在不知道有什么可以学。但是如果有一个东西你有一定的理解,但你又不能做到完全的正确和错误,但是有另外的一个人,他可能比你多懂一些,但也没有懂那么多,或者水平差不多,你们就可以相互切磋一下。三个臭皮匠顶过诸葛亮,在你们两个之间互相质疑、假设的过程中就可以学到很多。所以你和ChatGPT这样学生、老师的角色不停转换的过程就有点像一个辩证的过程,能让你更快、全方位地了解你想学的东西。

硅谷101:所以在数学题上,你觉得ChatGPT水平到底怎么样,它真的是跟你差不多吗?

左斯琦:你要说从整个的数学领域上,我懂的肯定是不如它多,它懂的东西那绝对是几千几万倍的比我多。只是说我现在在学的这一本书,或者这一个东西,我可能能学到跟它推理推的差不多,然后我可以跟它一起学习。但有一些它根本没有了解、比较非常细分的领域,比如说differential manifold那些就它可能没有训练过,那它就可能确实是不会有人那样的能力。但是如果我只想复习一些比如说线性代数这类比较基础性的数学问题,它是应该是没有任何问题的。

硅谷101:那现在综合来看ChatGPT在数学方向,哪些方向它是处理得比较好的,哪些方向它是不太懂的。

左斯琦:我其实也没有拿它学一些别的领域,但从ChatGPT开发的角度,现在做得很好的一件事情就是它知道把大语言模型和解决数学问题分开。因为我现在说的这些都是证明的问题,但它其实很多时候需要的是计算的问题。我们需要一个正确的答案,不能只是给我一堆证明就走了。那这种情况下现在可以用一些工具,ChatGPT把你的问题计划好,第一,第二,第三,第四做什么?然后它再把指令发给这些工具,比如wolfram alpha这种计算做得很好的工具,接着就可以得到一个非常准的答案。我觉得这是一个非常智能的一个方面。

硅谷101:之前我们讨论过,你说ChatGPT数学证明题它证对的概率大概是百分之三十。

左斯琦:是的。也是要看是什么样的题,看它的训练数据里面有没有或者类似的,这样它可能会正确率高一点。但如果你可以找出它的错误之处在哪里,通过几次的沟通之后,它自己最终给出正确答案的概率还是蛮大的。

硅谷101:如果你帮它纠正的话,它也会像人一样成长得很快。

左斯琦:对,它会发现自己之前的错误在哪里,然后通过几次沟通,它就会告诉你比较正确的答案,这是比较智能的。当然有一个问题就是如果这个沟通的次数特别多,超过五、六次之后,它就会忘掉之前的东西。基本上如果在个位数步数解决不了的问题,它确实之后也就一直解决不了。

硅谷101:也就是说一般五、六轮沟通以后,它对前文的印象并不深刻,或者它会忽视上下文。

左斯琦:这可能是ChatGPT它自己的记忆设计,但如果你自己可以开发一个新的记忆的方法,用API来做的话,可能就会不一样。

硅谷101:这算是它在软件设计上的一个缺陷吗?

左斯琦:这个倒也不一定是缺陷,因为其实平常可能也不是需要记住所有的这些细节。如果我每一轮跟它的聊天,我都会发非常长的长文,让它帮我做长文缩短之类的,那可能过了很久之后,它确实也没有办法记住很久之前的这些长文。

三、和ChatGPT共同协作开发游戏

硅谷101:你是怎么样用ChatGPT跟自己做讨论的呢?

左斯琦:平常当我在做一些课程项目或者自己感兴趣做着玩的一些项目,比如之前提到的那个做研究的RAG的时候,我会先有一个比较宏观的想法,我的点子非常多,但是我的缺点是我很难把东西做得非常细化。这时我就会和ChatGPT去聊具体细节,要怎么做这件事情。

我自己通过ChatGPT做过一个帮小朋友们学习知识的小游戏。我当时的想法是,可以把如世界地理知识、世界历史的知识变成一个个问题答案的形式,让小朋友操作一个小人,这个小人每次走到一个小猫旁边,小猫就会问他一个问题,回答对了,小人儿就得到奖励,回答错了就不给他奖励,就变成一个游戏化来学习知识。但我就只有这么一个想法,具体怎么做我一点都不知道,因为我此前没有做过任何前端的实现。

于是我就去问ChatGPT,让它告诉我具体的细节该怎么做,然后我就按它说的一步一步地执行再去问它。大概花了十个小时左右吧,我就把整个项目做出来了,虽然我没有任何的游戏开发经验。

硅谷101:是做出来了一款游戏?

左斯琦:对,这个游戏可能就比较简单,你能看到它就是有一个小人行走的系统,有一些小猫,小人、小猫其实在游戏里是可以跳来跳去的。有一个地图系统,然后还有一个经验系统,还有一个就是知识库系统。我做之前是不能想象我能这么快做出来的。虽然这个游戏看起来很简陋,但是它的学习到的东西还是挺多的。

左斯琦所做的小游戏界面图,由左斯琦提供

硅谷101:这个游戏做出来以后是在哪里运行呢?

左斯琦:它通过网页就可以打开,我自己之前在Github上放过一段时间,后来就把它关掉了,但是如果大家想玩儿的话,我可以再把它打开。不过这就是一个比较简单的小游戏,更像一个DEMO,更像是用来做示例。它并没有很多的细节,还有很大的改进空间。比如说你想拿它去Steam上卖啊,可能还有很长很长的路,它只是一个第一版。

硅谷101:是ChatGPT帮你写的代码还是你自己也有写一部分?

左斯琦:我当时做这个的时候的想法就是要让自己纯粹做一个产品经理,我只是提出我想要实现的东西,我发现有问题,就让ChatGPT给我改。虽然有一些代码我也会写,但是主观的就是让自己尽量一行代码都不要写,只做复制粘贴。所以可以说基本上所有的代码都是ChatGPT写的。当出现错误时,我会让它告诉我要怎么改,然后按它说的去复制粘贴,自己不去干涉它写代码的过程。

硅谷101:所以你跟ChatGPT玩了十小时,你有一个想法,它帮你实现了这个想法的雏形。

左斯琦:或者说句不好听的就是我作为一个资本家,剥削了ChatGPT十个小时。

硅谷101:当时用的是ChatGPT3还是4?

左斯琦:当时是4刚出来的时候。大概今年上半年或者是年中的时候,我突然有了这么一个想法就去试了一下,大概一个周末左右就搞出来了。

硅谷101:图形设计跟UI也是它做的吗?

左斯琦:这些图倒是我是谷歌搜索出来的。但是这些图要怎么在里边放置都是ChatGPT做的。

硅谷101:所以你是有给它喂一些图,然后让它去学习你这个图是怎么处理。

左斯琦:这些图其实也不是用来训练的,你只要告诉ChatGPT我有这些图,我想做这些事情,它就会帮你把代码写好,然后只需要把这些图在哪里告诉它就好了。

硅谷101:那么当这个小人他走到一个小猫或者一个小豆子旁边时,在你的这个游戏中是真的会出现一些问题的?

左斯琦:是的。它会出现一个新的问答界面,我到时候也可以把那个问答界面放到这里,那也是另外一个系统。

硅谷101:你的问答大概都是一些什么样的问题呢?

左斯琦:这个问题你可以自己去决定是什么,我当时放的就是一些世界地理常识答辩的问题,这些问题也是让ChatGPT给我生成的。

硅谷101:在你玩游戏的过程中,它有胡说八道吗?

左斯琦:没有,当时我一次生成了一百多个问题,我看了一下看起来都还挺正确的。

硅谷101:这个也很有启发,也就是说当有了ChatGPT这个工具,只要你有一个想法,每个人都能写出自己的游戏来的。

四、把ChatGPT变成能跟我聊天的“哲学家”

左斯琦:除了这个我还做了一个好玩的事。有一次我突然产生了一个想要跟ChatGPT聊天的想法,也就是我想把一些比如说哲学家放到里边,然后跟他们聊天。刚开始我尝试了很多的方法,比如说拿Facebook开源的大模型去做一些微调,让这个模型说话很像尼采,或者很像黑格尔。然后也试了很多如RAG的方法,就是让这个模型先读尼采和黑格尔的文档再做回答,这样去保证每一个回答都具有个性化,比如黄色的回答都是尼采的风格,每一个绿色的回答都像黑格尔的风格。接着当我问一个问题,就可以让他们可以和我共同建立起一个三个人的聊天室。

跟开发小游戏一样,我就是有这么一个想法,但具体如何去实现基本上也不是那么懂。所以我也像之前一样,把需求想清楚之后就告诉ChatGPT我要达到这么一个需求,写完之后有不对的地方我再让你改。这也是一个非常好玩的项目,大概十几个小时就完成了,而且其中主要的时间是花在如何让他们说话更像尼采和更像黑格尔,像这个聊天室可能就一个小时左右就可以做出来。

与哲学家的聊天室,由左斯琦提供

硅谷101:现在不是已经有挺多类似于Character.AI,模仿马斯克、比尔盖茨或者一些歌手说话或者角色扮演的AI软件了?

左斯琦:我这个主要就是想自己做着好玩,想学习和比较一下让AI说话更像某个人的方法,所以我自己做了一下,确实还挺好玩的。

硅谷101:那你做这个事情的时候,你觉得让AI生成不同的角色的时候,它的核心壁垒是什么呢?

左斯琦:看你的核心需求是什么。像我在做这个时候,我的核心需求就是想让他们之间聊天,聊出一些新的想法,然后给我一些灵感启发,我可能不是很在意他们的语言是不是更像人类,或者他们能不能和我建立足够的连接。

但我觉得像普通用户,比如用Character.AI的话,他们可能更多想要的是那种情感上的连接,比如得到一些慰藉之类的。那么在那种情况下,它除了要理解背后的人物之外还需要更多地理解这个用户,他到底想要什么。所以从这个角度上,这些项目可能会比我做的复杂得多。它的壁垒可能就在于,首先它要理解要扮演的这个角色,它需要这些角色足够多的数据。同时它还需要足够理解使用的用户,另外它的反应可能要足够快,不能让这个用户等很久。

五、ChatGPT与其他工具的区别及自我升级

硅谷101:除了很早就开始用ChatGPT,我知道你其实也是Claud.ai的深度使用者,包括刚才你也提到曾用Llama做过开发,你觉得这几个大模型软件在使用上有什么区别吗?

左斯琦:Claud我倒也不是那么深度,之前因为GPT有大概8000字的字符数限制,所以没有办法放很多的词,所以需要配合Claud使用。比如我读一本书之前需要把整个的第一章给到模型来帮我提炼宏观观点,之前我没法都给到ChatGPT。但后来ChatGPT有了Turbo之后,这个问题就很好地解决了。

为什么我还是会用ChatGPT呢?是因为我想要它直接生成表格的形式,这样可以粘贴到我的Spreadsheet流程里面。但Claud的效果还是没有ChatGPT好。所以我现在自己创建了一个GPTs,自定义了一个文本提示词,我就告诉它,第一步你先生成总结,第二步把生成好的总结再变成一个表格,这样它就可以很好地完成任务。但目前Claud的效果确实没有那么好。

硅谷101:GPT有提供更多的工具或者开发者组件吗?

左斯琦:它现在有一些功能,比如刚才说的数学,它知道你要去算东西的时候就会自动调出那个工具来帮你算,你不用自己去把这个工具调出来,或者它知道你问的这个问题模型调不出来。比如你想问今天湾区的天气是怎么样,它就会去网上进行自动给你搜索,不用你告诉它你去搜索一下。所以它现在就是非常的智能化。

硅谷101:在GPT4升级之后,有哪些你之前做不到的事现在做到了呢?

左斯琦:比如刚才提到的写Prompt提示词的流程。在之前基本上需要自己每次都大概写一些这样的流程,一做什么,二做什么,三做什么,四做什么。但现在你可以把它整合到GPTs里,它就相当于把你自己平常每天需要重复做一些东西扔给GPT。

比如说很多人可能炒股想看财报,你就想想你每次想看CAGR就是它每年成长多少,它的EBIT就是它的盈利能力,以及现金流这些。如果每次你都要看这些指标,你就可以把它写到GPTs里,告诉它一先看这个,二看这个,三看这个,然后把这些告诉我,接着直接上传这个财报,你就不用自己去看那些非常细节的东西,它都会直接告诉你。

硅谷101:那在使用ChatGPT的过程中,它有哪些做得还是没有人好的呢?

左斯琦:到目前为止它还是一个语言模型,它已经有一定智能,可能具备比较基础的逻辑能力。但相对比较复杂一点的逻辑能力,比如你问它一些不在一个提示词里面但可能在多个对话中的内容,比如说很久之前说了但过了一段时间又回到那个论点的时候,它是没有办法直接把这些东西记清楚的。它没有中期的记忆能力,它长期的记忆能力,你可以通过RAG实现,短期的记忆能力它直接用语言模型就可以实现,但是稍微中期一点的记忆能力它就可能没有办法搞得很清楚。

硅谷101:你刚刚有讲到当你在做数学证明题的时候,用几轮之后你能感受到ChatGPT的进步。那你觉得它的进步是基于你自己的交互训练,还是整个模型都有进步了?

左斯琦:其实很多人都说,ChatGPT它本身模型从GPT4出来一直到开发者大会之前是在下降的,我也可能理解就是OpenAI其实这半年做的就要在降低成本,让更多的人可以用到它。但是它在功能上,尤其在开发者大会之后提高确实挺多的,比如说文生图等各类工具,以及Prompt Flow等。

这是在功能上的提高,但在开发者大会之前模型的提高倒是没有那么多。模型的处理能力下降这其实有很多人提供数据点,然后有很多论文也都提到了这个东西。但是这是在开发者大会之前,但开发者大会之后,这个新的GPT Turbo确实是比之前的那个模型有很大的提高。

硅谷101:所以Turbo之前的GPT4是下降的,但是Turbo之后又有一个很大的提升。那之前GPT4下降的逻辑是因为它要去降成本,那Turbo能力的提升是不是因为用了更多的数据去训练、模型更大?如果是这样的话,OpenAI怎么去同时兼顾降成本跟效果更好这件事情呢?

左斯琦:我觉得这些应该是OpenAI的内部的机密,就是它内部肯定有一些提高的方法。最近这半年也有很多关于如何提升模型效率的论文。在OpenAI内部应该有比这些大家都能看到的东西更细节的一些优化。至少这半年他们在一轮一轮改进的时候,可能优先级会是提升模型的效率和降低它的价格,而不是提升模型的准确性。

硅谷101:OpenAI的开发者大会上除了你之前提到的GPTs,还有什么产品是让你特别惊艳的?

左斯琦:我其实还没有花很多时间去研究,但是我对Assistant API比较好奇。对我来说,我很喜欢做一些类似于AI agent的东西,因为我对这种可以自我成长的Agent(Self-improving AI agent)非常感兴趣。

目前我觉得它这个API还做不到能自我成长,但如果它这个Assistant API大家用得越来越多,可能就会推进更多的人来做这些东西,到时候整个这个市场上就可能会有很多多样性。而且会有很多资本注入进来,有更多的人研究这个领域,到时候可能真正去开发能够自我成长的Agent,进而能真正能解决很多的问题。

因为现在包括OpenAI开发的Prompt Flow、GPT4,它们的问题是仍然是一个被定义好的东西,你要做一二三四五,它是没有办法很大程度上自己改进自己的。但如果AI它可以在大语言的架构下有自己的记忆,有自己改进自己记忆、自己成长的一套的范式的话,我觉得它的智能性会大大提高。所以如果之后大家都在用Assistant API,可能会大大推进这个过程。

硅谷101:现在似乎大家都在提AI agent,但是很多人都并不知道AI agent是什么。包括你说的这个自我成长的Agent,它具体是什么意思呢?能不能举一个小例子来给大家简短地解释一下?

左斯琦:我觉得目前其实并没有一个非常确定的定义。但我的理解是一个能自我成长的Agent需要有什么呢?首先它需要有自己的记忆,它有自己去规划的能力,它有自己逻辑的能力,它还有改变自己记忆的能力。Agent就像一个人一样,是有自我意识的一个人。当然,我觉得自我成长不一定非要有意识,但如果它要像人,平常在做事情的时候,它就需要通过自己的记忆、决策能力和外界进行反应,比如使用工具或者与外界进行交互,然后来改变自己的记忆,从而不断发展的这么一个个体。

现在的这些Agent它只能完成一些比较固定的东西。你去帮我把这个文章读一遍,把这个东西找出来。但如果有自我成长的话,它就可以自己主动去改,去发现有哪些可以自我改进和提高的方法。你就可以告诉它一些没有那么细节、那么确定的东西,比如现在你需要告诉它一篇论文有什么可以提高的方法,有什么比之前进步的地方,这篇论文它的实现用到了哪些库?

但如果是一个有自我成长能力的Agent的话,那它就可以在自己读了很多论文之后,通过之前的学习就可以自己告诉你所有的东西,而不需要你去告诉它更多的细节和定义。这是一个我能想到的比较简单的案例。

硅谷101:我的理解是,你现在在使用ChatGPT去学哲学、数学的时候其实自己还搭建了很多的工具,然后你需要把所有的这些工具全都拼起来。但有了AI agent之后,你其实就可以把整个工作流程告诉它,让它自己去执行,你只用问问题就OK了。

左斯琦:甚至如果它可以自我成长的话,它可以自己改变自己的工作流。就比如我现在告诉它的工作流是建房子吧,你先把砖搬过来,再搭水泥,再搭木头。但如果它自己可以学习,它有记忆,它就会发现其实我先搭木头比先搭砖头要好,所以它自己可以做规划,然后它可以告诉自己原来这样是更好的,这就是一个可能的比较智能的发展方向。

硅谷101:就是它可以去做执行了,然后它执行的时候还是带脑子的。那从现在看,这些大模型发布的软件,有没有什么是你特别想要它去提升或者改进的功能,但目前还没有实现的?

左斯琦:因为我是一个通过图像来学习的一个人,我的想法就是如果有这么一个功能,当我把一本书告诉它,它就可以给我生成一个可以互动的思维导图。比如我给它一本数学书,或者是物理书,甚至是哲学书,它直接可以把它宏观的这些点呈现给我。当点一下某一个宏观的点,它又能自动生成这个宏观点下面的这些小点。然后就有一个你可以和它进行互动学习的方法,这个对我来说会有很大的帮助,它可以建立每个点之间的联系。现在我自己也在做类似这样的功能,比如把一个宏观的点变成一个表格。

目前这个可以用工具实现,但我自己试了很多次,发现它最大的问题在于当你生成了第一层宏观点之后,到第二层它可能还可以,但当层数越来越多之后,它离原来的这个文本和概念就差得有点远了。它不是一次生成宏观到微观的这么一个系统,而且也不是非常的可以互动的。

硅谷101:就像之前提到的它进行到五到六轮对话以后对上下文的理解能力就不太好了。是不是生成思维导图也会有这样一个问题,当思维导图往下延到五到六层的时候,就做不下去了。

左斯琦:因为它没有办法一次既做到非常宏观又做到非常细节,这对它来说是一件很难的事情。就相当于是既要、都要,对于一个模型来说它至少目前还是很难实现的。

硅谷101:思维导图它其实是有逻辑的,甚至逻辑是非常非常严密的,大模型它在处理这种逻辑问题或者涉及到很多层逻辑问题的时候,它的能力怎么样?

左斯琦:它的逻辑并不是非常严谨,包括做总结简述时候它都会把一些层数搞错。比如做第一层、第二层的时候可能是对的,但做到第三层可能就会跟第二层的颠倒,它是很难搞清楚的。

六、AI和人是否具有意识的哲学思辨

硅谷101:刚刚你说自己学东西是用图像来学习的,我就想到了爱因斯坦的思维也是非常图像化地去处理问题。你有做过智商测试吗?

左斯琦:我小时候有一个什么留学生项目去新加坡读书,他们是有做过这些东西。但我想说的一点是,从我个人的角度,我认为其实智商测试更像是一个为了区分大家而区分大家的一件事情,我不觉得智商测试会对生活有什么特别大的指引作用。有人之前做了一个论文,说其实智商测试的分数高只和你做智商测试的能力有关,和其他的都没有很大的关系。

我们平常做的MBTI、 IQTEST,或者说看收入、职位啊这些东西,其实是一种智力上的偷懒,因为我们的时间就这么多,和这个人能接触的时间这么多,自己能思考的时间有这么多,我们就相当于给对方一个最简单的标签,然后之后能找到这个人。但是这些东西它具体准不准,好不好,其实很难去分析。我觉得只能把这个做一个工具主义的方法去想,具体它是好是坏这是一个非常哲学的问题。

硅谷101:既然讨论到这个话题了,想稍微多讨论一点点。因为你也在学哲学,从哲学的角度,你怎么看人工智能是不是有意识,以及由此而延伸来人是不是真的有意识的这个话题。因为最近就有一个嘉宾,他说他越来越相信人也是没有意识的。

左斯琦:我想请问他认为的意识大概是什么样的。比如说人的哪些方面反映或者不反映意识?我觉得这个东西是需要更多地解释清楚的。

硅谷101:我们现在的所有的行为或许都是基于我们对过往的事情的记忆,对过往事情的一些机械反应甚至是我们的经验。机器现在大模型的训练不也是这样子的吗?

左斯琦:我觉得这个角度是很好,但可能从实际生活经验角度来想的话,我觉得它能解决什么问题比去探讨它有没有意识,这个问题本身是一个更好的问题。有没有意识、有没有上帝、灵魂是不是不朽,我觉得这些都是有一种非常形而上的东西在里面,当哲学Language Term发生了之后,这些东西就都变成了一些不是很有用的问题。

至少从我的角度,就会发现这些东西你从正面说可以,然后换一个角度去说,它好像也可以。很多形而上的东西,你去讨论它的时候,自己会处在两个不同的语境中,就是你用一个方面说它有意识,你会发现它也说得通,你另一方面说它没有意识好像也说得通。

确实世界上很多东西,是没有办法用足够的语言去定义它的。比如你问什么是意识,你去解释意识的时候,针对这个解释你又可以问他那什么是ABC,他又用D解释,你可以去问什么是D。这么一直问下去,什么东西都可以被解构到什么都没有这个程度。

但是这样当然是不好的,但如果哪怕你给一个差不多就是大家能公认的定义,大家想去从两方辩证的时候,也都会在自己的语言世界里给出一个足够有解释力的答案。其实在举出这些非常形而上的东西的时候,就会把这些回答者分到不同的语言世界里面。所以有时候你并不是在回答、在讨论,你只是在不同的语言世界做一些解释。

硅谷101:所以你觉得哲学它解决的本质问题是什么呢?或者哲学的本质是什么呢?

左斯琦:我觉得就是Clarification,把问题回答清楚。因为在很久之前当时还没有科学,也没有语言学,很多东西都是混沌一体。哲学家他也可以是个物理学家,也可以是计算机学家、数学家。但后来有了科学之后,大家很明显的看到科学的方法是可以解决生活中的问题的。

与其讨论什么灵魂不朽、上帝存在这些可能非常形而上学的问题,他们发现与其做这个,不如去做积分、去做动力结构、做人工智能大数据,这些东西确实能解决生活中的很多问题的。哲学可能最大的意义就是它可以让你把这个问题去想清楚,也不一定能想得很清楚,但是至少能让你clarify到底想要的是什么。

此外,它也可以给你更多的思考角度。因为我一直也是接受理科教育,只是在大学的时候读了几门哲学课,但我觉得如果只是按纯理科的想法就会想世界就是一个理性的金字塔式结构,我只要顺着理性往上走,世界就会存在一个理性的终点,当我到那一点,我就可以把握整个全世界的知识,世界一切都会make sense,没有什么理性不能解决的问题。但是当我读了很多诸如休谟、尼采之后,就发现其实有另外一个角度,就是你可以不用这么去想,而且那么去想反而会是有害的,世界并不存在纯粹的理性。

我之前看过很有意思的一个书它就说如果你努力就成功,你的事业就会有下一个可以追求的目标。就像是你小时候上学的时候,你去了一年级就会有二年级,二年级就会有三年级,你题做对了就会拿一百分,你做得好就会有小红花,这就是一个很理性的系统。

但是当你长大了,你变成了成年人之后,这个世界就不存在了,而当你没有这么一个熟悉的环境之后,你就要创造这么一个环境。于是,你要在社会中找到这么一个职场的阶梯,你要找到在学术界也有这么一个阶梯。你要找到你住的房子、更好的车子,实际上你是一个没有长大的人,你主要为了回到你小时候这个熟悉的感觉,然后给它冠以一个理性的名字。

所以其实有时候跳出来,认为什么东西都存在一个解释、存在理性,反而其实让自己有一种解脱,能够回到这个现实中。然后像尼采说的那样,你做一个强大的人,在这个非常不确定的世界里边自己给自己做决定,而不是靠着所谓的这种理性回到自己熟悉的这个小环境中。

硅谷101:你做的事情是跨了非常多学科的,哲学、数学、计算机,包括现在跟大模型、人工智能的各种交互。如果我们把这些跨学科都融合在一起,你觉得它们中间的共同点是什么?

左斯琦:从我自己来说,我并不是每个领域的专家,只是对这些东西感兴趣,学这些东西也是纯粹为了自己觉得好玩、开心,就是一个充满好奇的状态。对我来说, 它们的唯一的共通点就可能是让我有一种很开心的感觉吧。它们都是一种大家之前想过的问题,而且都是想过之后被大家接受的问题。在历史里它们都是经历了很多很多的人类讨论和总结,只有这些非常好的能被大家不断引述的东西留下来了。

我自己去学的时候,我就能从中发现一种美感,而不是说一种逻辑、一种知识,不是说我学会了它,我就可以占领某种权力结构。很多人可能会这么想,就觉得我学了这么多,我就可以变成一个很有权力的人,我会了这个我就可以变成CTO、会了那个我可以做CEO。但我看这些东西并不是期望带给我一些能力,而是像艺术一样,是被人类多少年来筛选后流传下来的,就非常美。

配合ChatGPT使用的相关工具:

-

Spreadsheet(电子表单):电子数据表,模拟纸上计算表格的计算机程序,类似于EXCEL。它会显示由一系列行与列构成的网格。单元格内可以存放数值、计算式或文本。

-

Audible:亚马逊旗下的全球最大的有声电子书制作和分发平台。

-

Speechify:文本转语音和语音转文本工具。

-

RAG(检索增强生成):是指对大型语言模型输出进行优化,使其能够在生成响应之前引用训练数据来源之外的权威知识库。

本文来自微信公众号:硅谷101(ID:TheValley101),采访:泓君,图文:Daisy